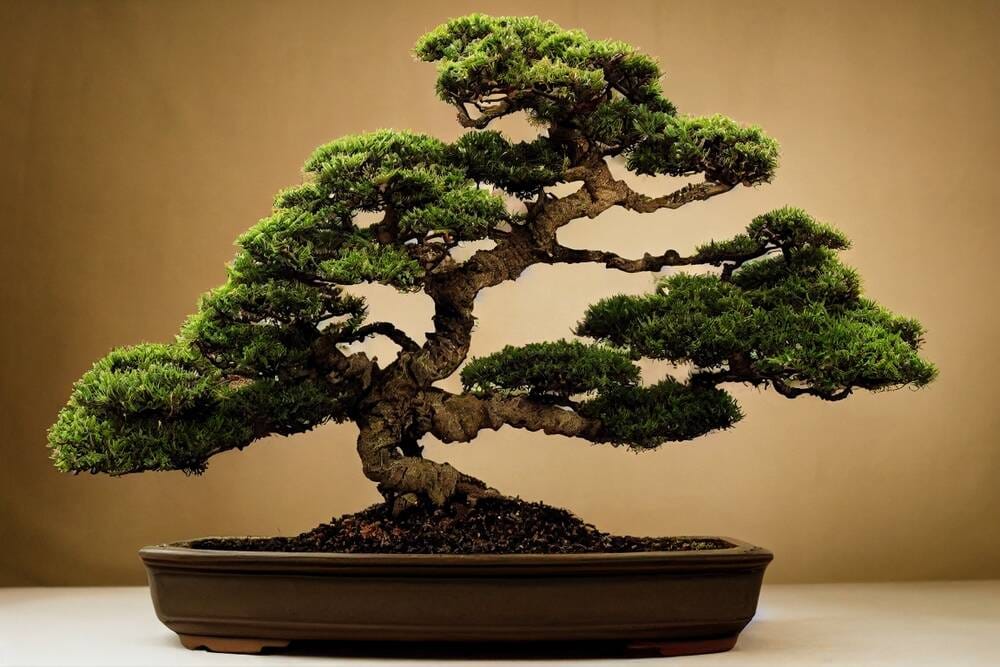

PrismML, 1-bit LLM ile AI’nın Enerji Tüketimini Azaltıyor

Caltech çıkışlı girişim PrismML, 14 kat daha küçük ve 5 kat daha az enerji harcayan 1‑bit Bonasi 8B modelini tanıttı; mobil AI’da devrim vaat ediyor.

Giriş

Kaliforniya Teknoloji Enstitüsü (Caltech) temelli yapay zeka girişimi PrismML, Bonasi adlı 8 milyar parametreli (8B) büyük dil modelini (LLM) 1‑bit kuantizasyonla sunarak sektörde dikkat çekti. Şirket, modelin geleneksel 8B rakipleriyle rekabet edebildiğini, ancak 14 kat daha küçük bir bellek ayak izine ve 5 kat daha düşük enerji tüketimine sahip olduğunu belirtiyor.

Teknoloji ve Model

1‑bit kuantizasyon, model ağırlıklarını yalnızca iki seviyeye indirger; bu sayede hem depolama hem de işlem maliyetleri büyük ölçüde azalır. Geleneksel LLM’ler 16‑bit ya da 32‑bit hassasiyetle çalışırken, PrismML’in yaklaşımı, aynı görevlerde benzer doğruluk seviyeleri sunarken enerji verimliliğini artırıyor. Bonasi 8B, özellikle akıllı telefonlar, nesnelerin interneti (IoT) cihazları ve uç‑bilişim (edge computing) ortamları için tasarlandı; bulut tabanlı sunuculara bağımlılığı azaltarak gecikme süresini kısaltıyor.

Piyasa ve Gelecek

AI uygulamalarının bulut maliyetleri ve karbon ayak izi tartışmaları sürerken, PrismML’in çözümü hem işletmeler hem de geliştiriciler için ekonomik bir alternatif sunuyor. Mobil asistanlar, gerçek‑zamanlı çeviri ve görüntü işleme gibi enerji yoğun senaryolarda Bonasi’nin düşük güç tüketimi, cihaz ömrünü uzatabilir. Şirket, modelin açık kaynak versiyonunu da planlayarak ekosistemi genişletmeyi hedefliyor; bu adım, akademik araştırmalardan start‑up’lara kadar geniş bir kullanıcı kitlesine ulaşmasını sağlayacak.