AI ajanları sahneye çıktı: Claude, OpenClaw ve yeni gerçeklik

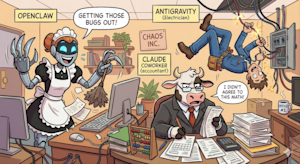

Claude, OpenClaw ve Google Antigravity gibi otonom AI ajanları, iş dünyasını dönüştürürken güvenlik ve düzenleme tartışmalarını da beraberinde getiriyor.

Giriş

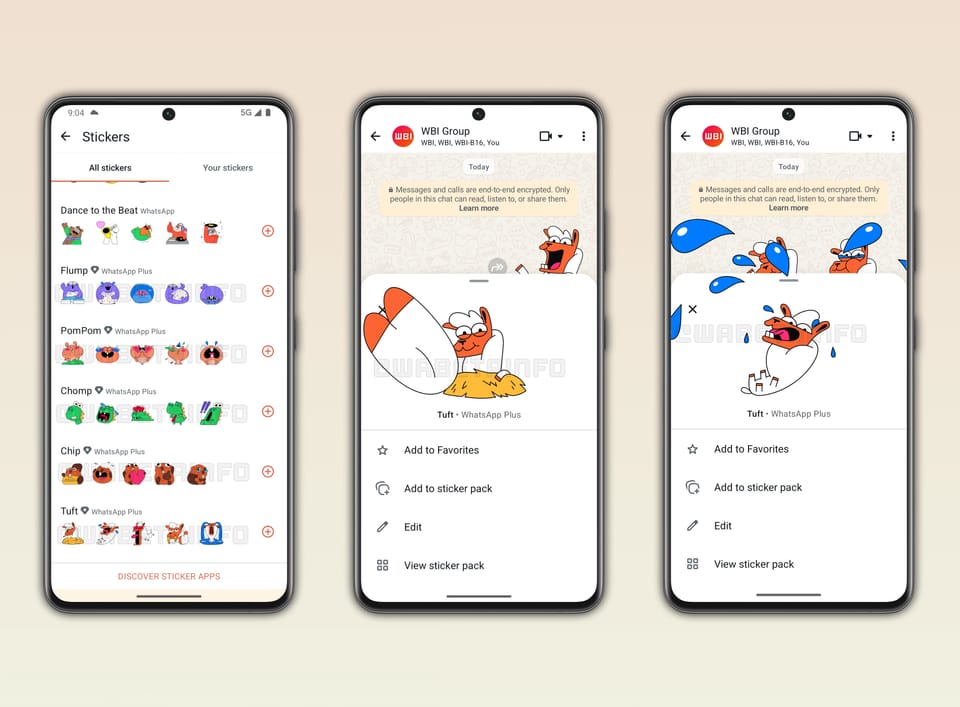

Yapay zekâ alanında ajan temelli sistemlerin yükselişi artık bir gelecek senaryosu değil; gerçek bir dönüşüm sürecidir. 2022 yılında ChatGPT ile başlayan basit soru‑cevap etkileşimleri, bugün Claude Cowork, OpenClaw ve Google Antigravity gibi güçlü otonom ajanların piyasaya sürülmesiyle iş güvenliği ve etik kaygılarını gündeme taşıyor.

Teknoloji ve Pazar Dinamikleri

OpenClaw, önceki adıyla Moltbot, kısa sürede 150 000 GitHub yıldızını aşarak açık kaynak topluluğunun dikkatini çekti. Derin sistem erişimi sağlayabilen bu ajan, dosya yönetiminden e‑posta sınıflandırmasına kadar geniş bir yelpazede görev yapabiliyor. Google’ın Antigravity’sı ise kodlama odaklı bir IDE entegrasyonu sunarak, geliştiricilerin tek bir komutla tam bir uygulama oluşturmasını mümkün kılıyor. Anthropic’in Claude Cowork’u ise hukuk ve finans gibi yüksek düzenlemeli sektörlerde sözleşme incelemesi ve vergi hesaplaması gibi uzmanlık gerektiren işleri otomatikleştiriyor.

Riskler ve Düzenleyici Çerçeve

Bu ajanların yetkilerini artırmak verimliliği yükseltirken, veri sızıntısı, hatalı kod enjeksiyonu ve yasa dışı muhasebe işlemleri gibi riskleri de beraberinde getiriyor. Açık kaynaklı OpenClaw’da merkezi bir denetim mekanizması bulunmaması, sorumluluk zincirini zorlaştırıyor. Dolayısıyla Anthropic ve Google gibi sağlayıcıların şeffaflık, izlenebilirlik ve insan onayı gibi sorumlu AI ilkelerine sıkı sıkıya bağlı kalması şart. Ortak bir ontoloji ve dağıtık kimlik çerçevesi, ajanların eylemlerini standartlaştırarak kaosu önleyebilir ve iş gücünün yüksek katma değerli görevlere odaklanmasını sağlayabilir.